Le débat interne : les Facebook Ads fonctionnent-elles encore ou le canal est-il saturé ?

À mi-trimestre, l’équipe growth avait déjà arrêté deux canaux.

TikTok ne tenait pas. Google devenait trop cher. Et les Facebook ads — pourtant leur moteur d’acquisition principal — perdaient de leur efficacité.

Ce n’était pas une chute brutale.

Juste une stagnation.

CTR autour de 0,90 % (WordStream, 2024), CPA qui grimpait doucement, et les créatifs qui s’essoufflaient plus rapidement.

Personne n’arrivait à pointer un problème précis.

Mais tout le monde avait cette même impression.

Une perte de confiance lente.

Dans Slack, une question résumait tout :

« Est-ce que les Facebook ads fonctionnent encore… ou est-ce qu’on alimente juste un canal saturé ? »

Le problème n’était pas l’effort.

L’équipe lançait des ads chaque semaine, mettait à jour les créatifs, suivait les performances.

Mais rien n’évoluait.

Alors ils ont pris une décision rare.

Ils ont arrêté de discuter.

Et ont décidé de tester.

Définir ce que “fonctionner” veut dire aujourd’hui

Avant même de lancer leur expérience, ils ont clarifié un point clé : qu’est-ce qu’une campagne qui fonctionne vraiment ?

Les clics seuls ne suffisent pas — Meta insiste lui-même sur l’importance de la portée et de la fréquence, pas seulement du CTR.

Ils ont donc posé trois critères :

- Un CPA stable dans leur fourchette cible

- Un créatif scalable par lot

- Un apprentissage mesurable à chaque cycle

Ce dernier point a changé la donne.

Car une campagne performante ne génère pas seulement des résultats.

Elle génère des insights.

Et surtout, elle permet d’apprendre plus vite que les concurrents.

Des données Nielsen et Meta montrent que la qualité créative peut expliquer jusqu’à 56 % de la variation du ROAS (Nielsen x Meta, 2023).

Autrement dit : plus de la moitié de la performance dépend du créatif.

Ce chiffre a redéfini leur approche.

Ce n’est plus une question de ciblage.

C’est une question de volume créatif.

Hypothèse reformulée :

Les Facebook ads fonctionnent — mais uniquement si vous testez suffisamment de créatifs.

Concevoir l’expérience : 30 publicités pour créer un vrai signal

Le protocole était volontairement simple :

- Un produit

- Une audience

- Une offre

- 30 variations créatives

Pas de segmentation compliquée.

Pas d’optimisation avancée.

Une seule variable testée : la diversité créative.

Ils se sont appuyés sur des benchmarks réalistes :

- CPM médian : 13,48 $

- ROAS médian : 1,93 (Triple Whale, 2025)

Chaque publicité tournait entre 3 et 5 jours pour sortir de la phase d’apprentissage.

Objectif : détecter un signal.

Car une autre statistique structure tout le raisonnement : seulement 5 à 10 % des créatifs deviennent réellement performants (Meta données agrégées agences, 2024).

Si vous ne testez pas assez, vous ne trouverez jamais ces gagnants.

Mini-exemple : transformer un angle produit en 10 variations créatives distinctes

Point de départ : un angle simple.

« Gagner du temps au quotidien. »

Plutôt que d’optimiser une seule publicité, ils ont décliné cette idée en plusieurs directions :

- Angle problème : « Vous perdez encore des heures ? »

- Angle résultat : « Divisez votre temps par deux »

- Preuve sociale : « +10 heures gagnées par semaine »

- Angle peur : « Vos concurrents vont plus vite »

- Démo vidéo vs image statique

- Copy courte vs longue

En une heure : 10 variations.

Puis ils ont répété avec deux autres angles.

30 ads.

Meta indique que les campagnes avec plus de 5 variations actives peuvent réduire le CPA d’environ 25 % en moyenne (Meta internal data, 2024).

L’insight clé ici n’est pas la créativité pure.

C’est la structure.

Comme expliqué dans Pourquoi vos tests créatifs échouent (et comment automatiser la solution), ce n’est pas l’idée qui manque — c’est la capacité à la décliner.

C’est exactement là que l’IA entre en jeu.

Avec des outils comme Claude Code, l’équipe a pu multiplier rapidement les angles, reformuler les messages, et générer des variantes à grande échelle.

L’IA ne remplace pas la stratégie.

Elle accélère la production.

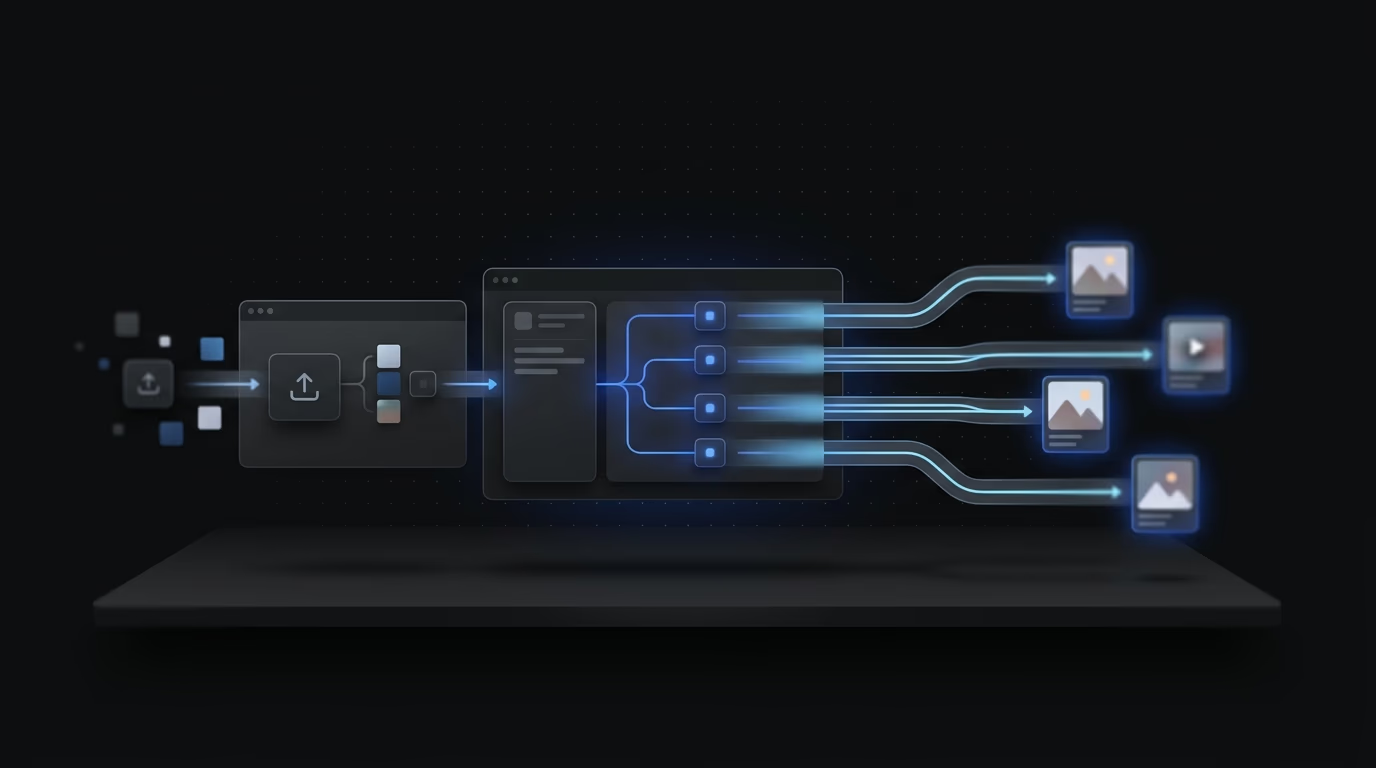

Couche d’exécution : upload en masse vs blocages du lancement manuel

C’est ici que tout se joue.

Pas dans la stratégie.

Mais dans l’exécution.

Créer 30 publicités manuellement dans Ads Manager prend entre 15 et 30 minutes par publicité.

Soit plusieurs heures — voire plusieurs jours.

L’expérience devient alors impossible à exécuter correctement.

Ils ont donc changé de workflow.

Ils ont utilisé un Facebook ads uploader : Instrumnt.

Processus :

- Créatifs structurés dans un tableur

- Nommage standardisé

- Upload en masse en un seul flux

Résultat : un gain de temps estimé entre 80 et 90 % (benchmarks opérationnels agences, 2024).

Mais surtout : la possibilité de tester à grande échelle.

Ce changement révèle un problème structurel du marché.

Des outils comme Madgicx ou Revealbot sont excellents pour l’optimisation (règles, budget, reporting).

Smartly.io permet de scaler à très grande échelle côté infrastructure.

Mais aucun ne résout le problème principal : produire et lancer suffisamment de créatifs.

Comme expliqué dans Pourquoi la plupart des ad management platform se trompent (et quoi faire à la place), l’optimisation ne remplace pas l’exécution.

Sans volume, rien ne fonctionne.

Résultats : ce qui change quand la vitesse de test augmente

Deux semaines après le lancement, les résultats sont clairs.

La majorité des publicités étaient moyennes.

Mais trois ont réellement performé :

- CTR > 1,8 %

- CPA -28 %

- Performance stable après scaling

Trois publicités.

Suffisant pour rentabiliser toute l’expérience.

Mais surtout pour répondre à la question initiale.

Oui, les Facebook ads fonctionnent.

Mais uniquement si vous créez suffisamment d’opportunités pour trouver ce qui marche.

Évolution :

- Ads lancées par semaine : 6–8 → 30+

- Temps de production : ~6h → ~1h

- Créatifs gagnants : 0–1 → 3

- CPA : en hausse → stabilisé

Le levier n’était pas le ciblage.

C’était le volume de tests.

Ce que l’équipe a compris

Conclusion simple.

Le canal n’est pas saturé.

Il est sélectif.

Meta touche encore plus de 3 milliards d’utilisateurs actifs quotidiens (Meta earnings, 2024).

L’opportunité est toujours massive.

Mais la concurrence est plus forte.

Et cette exigence passe par la variation.

Trois leçons :

1. Le volume créatif est le vrai levier

Le budget ne fait pas évoluer une campagne.

Les variations, si.

Sans volume, vous jouez à la loterie.

2. Les workflows manuels créent des plafonds

Le problème n’était pas stratégique.

Mais opérationnel.

Comme le montre Facebook Ads Test Automation : arrêtez de tester manuellement, la lenteur bloque l’apprentissage.

3. Les outils d’optimisation ne suffisent pas

Ils amplifient les gagnants.

Mais ne les trouvent pas.

Le système qui a relancé la performance

À la fin, l’équipe n’avait pas seulement une réponse.

Elle avait un système :

- Générer plusieurs angles par idée

- Utiliser l’IA (Claude Code) pour multiplier les variations

- Lancer en masse via un Facebook ads uploader comme Instrumnt

- Mesurer par batch

- Réinjecter les apprentissages

Une boucle d’apprentissage.

Chaque cycle améliore le suivant.

Comme détaillé dans Boucles d'apprentissage Facebook Ads automatisées avec Instrumnt et Claude Code, c’est cette répétition qui crée un avantage durable.

La vraie question devient alors :

« À quelle vitesse apprend-on ? »

Conclusion : le vrai problème n’est pas le canal

Si les Facebook ads semblent moins efficaces, ce n’est pas le canal.

C’est le système autour.

Pas assez de tests.

Trop de manuel.

Pas assez de variations.

Les équipes qui gagnent aujourd’hui ne sont pas plus intelligentes.

Elles testent plus.

Elles vont plus vite.

Elles exploitent mieux l’IA.

Et surtout, elles comprennent une chose :

Facebook ads fonctionne toujours.

Mais uniquement pour ceux qui jouent selon les nouvelles règles.

Common questions about do facebook ads work

Do Facebook ads still work for small businesses?

Oui, mais uniquement si le volume de tests est adapté. Même avec un petit budget, structurer des variations créatives peut faire la différence.

What budget do you need for Facebook ads to be effective?

Il n’existe pas de seuil universel. L’important est d’avoir assez de budget pour tester plusieurs variations et générer un signal exploitable.

Why do some Facebook ad campaigns fail while others scale?

La différence ne vient généralement pas du ciblage ou du budget, mais du volume de tests créatifs et de la vitesse d’itération.